![]()

Les équipes de Mageia font face à un défi inédit. Habituellement peuplées de robots bienveillants, leurs serveurs web sont désormais la cible de vagues massives de robots d’intelligence artificielle. Cette nouvelle forme d’activité numérique met à rude épreuve l’infrastructure habituée aux visiteurs plus… courtois.

Les sentinelles numériques : Hier et Aujourd’hui

Depuis les aurores du web, nos plateformes numériques cohabitent avec une faune robotique. Majoritairement, il s’agit d’agents logiciels indispensables et bienveillants, tels que les fameux crawlers des moteurs de recherche. Ces derniers, garants de l’actualisation des index, se conforment scrupuleusement aux protocoles établis dans nos fichiers robots.txt, agissant comme de véritables gentilshommes du réseau, explorant nos pages sans heurts et respectant les limites imposées.

L’émergence des explorateurs de l’ombre : Les bots IA

Cependant, le paysage numérique a radicalement changé. Nos équipes observent une recrudescence alarmante de robots d’un genre nouveau, pilotés par des intelligences artificielles. Ces entités autonomes ignorent souvent les directives de nos fichiers robots.txt, se comportant comme de véritables bulldozers numériques. Leur objectif ? Collecter d’immenses volumes de données, souvent pour alimenter et entraîner de nouveaux modèles d’IA, sans égard pour la charge serveur ou la consommation de ressources. Ces bots, souvent conçus pour le web scraping agressif, représentent une menace bien plus complexe que de simples crawlers.

Impact sur l’infrastructure : Le fardeau invisible

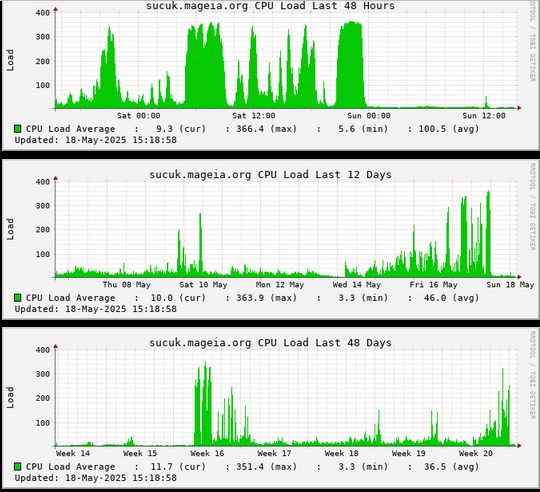

L’impact est direct et palpable. Ces dernières semaines, Mageia a enregistré une augmentation de plus de 300% du trafic non identifié, générant une charge serveur sans précédent. Nos systèmes, optimisés pour un usage humain et des bots respectueux, peinent à contenir ce déferlement. Selon nos analyses, près de 60% des requêtes proviennent désormais d’adresses IP uniques, témoignant d’une distribution agressive des requêtes sur un large éventail de sources, rendant la tâche de filtrage d’autant plus complexe.

« C’est comme si des milliers de bibliothécaires s’étaient soudainement mis à photocopier chaque livre sans demander la permission, saturant nos machines, » explique un administrateur système de Mageia, visiblement préoccupé par cette « cyber-invasion ».

Au-delà de la bande passante : Les enjeux éthiques et techniques

Au-delà de la simple question de la bande passante et de la puissance de calcul, cette invasion soulève de profondes questions éthiques. Ces robots moissonnent potentiellement du contenu pour des objectifs commerciaux ou de développement d’IA, sans attribution ni compensation. C’est une menace directe sur la souveraineté numérique et la valeur du contenu que nous créons et partageons librement, posant les bases d’un débat sur la régulation des activités d’IA sur le web.

Face à cette nouvelle donne, les équipes de Mageia sont mobilisées pour adapter leurs stratégies de défense. L’heure est à la réflexion sur de nouvelles méthodes de détection et de blocage, plus sophistiquées que les simples directives de robots.txt. Il est impératif d’innover pour préserver l’intégrité de nos infrastructures et la valeur de nos contributions. Cette bataille est un prélude à un futur où la gestion du trafic bot IA deviendra une composante cruciale de la cybersécurité pour tout acteur du web.

Pour approfondir cette situation et les mesures envisagées par Mageia, vous pouvez continuer la lecture sur notre blog officiel.

Mots-clés : Mageia, bots IA, cyberattaque, robots.txt, infrastructure web, surcharge serveur

Source : Article original